Il documento richiede l’uso sicuro ed etico della progettazione proteica con questi nuovi strumenti

L’intelligenza artificiale (AI) ha portato una rivoluzione nella ricerca nel campo delle scienze biologiche, consentendo la progettazione di nuove proteine, gli elementi fondamentali della vita. Questi dati possono spingere lo sviluppo di nuovi farmaci che rispondono rapidamente alle epidemie infettive, curano le malattie o aiutano a mitigare il cambiamento climatico. Tuttavia comportano anche grandi rischi, soprattutto il loro utilizzo nella creazione di armi biologiche. Per questo motivo, un’iniziativa lanciata venerdì scorso, già sottoscritta da più di un centinaio di scienziati di tutto il mondo, mira a garantire l’uso sicuro ed etico della progettazione delle proteine con l’intelligenza artificiale. Tra gli esperti c’è Frances Arnold, del California Institute of Technology (Usa) e premio Nobel per la chimica nel 2018 per essere uno dei ‘padri’ dell'”evoluzione diretta”, la creazione di proteine in laboratorio con gli stessi principi che utilizza evoluzione naturale.

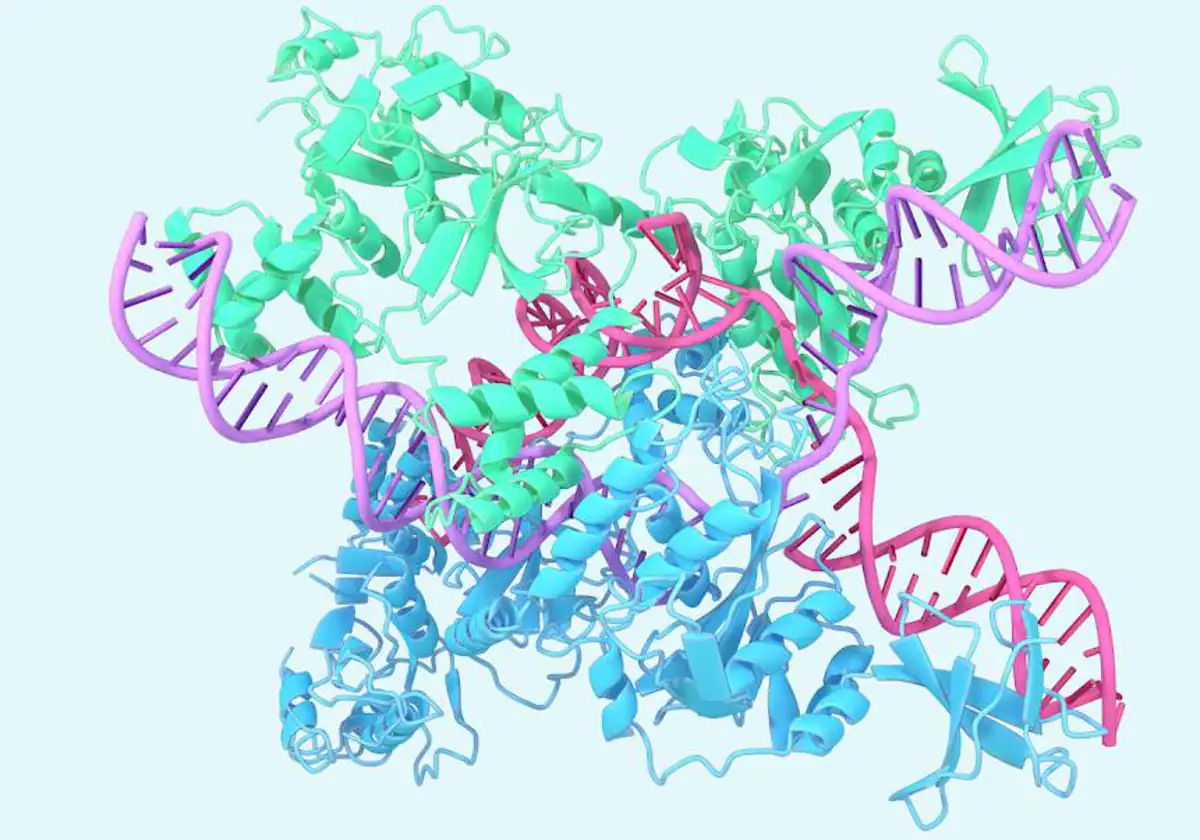

La proposta risponde a diversi rapporti del Congresso americano e di gruppi di esperti che temono la possibilità che questi strumenti possano facilitare lo sviluppo di nuove tossine o virus altamente trasmissibili da utilizzare come armi biologiche. Uno di questi è AlphaFold, di DeepMind, una società di Google, che è riuscita a prevedere la struttura di milioni di proteine, quasi tutte quelle conosciute dalla scienza. Alla stessa cosa lavorano modelli linguistici simili al celebre ChatGPT, come ESMFold, di Meta, capace di svelare 700 milioni di proteine del mondo metagenomico, microbi che vivono nel suolo, nelle profondità dell’oceano e perfino nel nostro intestino. L’intelligenza artificiale ha accelerato la progettazione delle proteine. Gli sforzi che prima richiedevano anni ora vengono compiuti in pochi minuti. E quasi tutto è disponibile gratuitamente. Nel testo, i firmatari assicurano che i benefici di queste tecnologie “superano di gran lunga il potenziale danno e vorremmo garantire che la nostra ricerca continui ad essere vantaggiosa per tutti in futuro“. Per fare ciò, gli esperti richiedono che la comunità scientifica si governi con un insieme di valori e principi che includano sicurezza, apertura e collaborazione internazionale. Pertanto, chiedono di rivedere periodicamente le capacità degli strumenti di intelligenza artificiale e di monitorare le pratiche di ricerca.